开年,DeepSeek论文火遍全网,内容聚焦大模型记忆。 无独有偶,谷歌近期也发布了一篇被誉为“Attention is all you need”V2(Nested Learning: The Illusion of Deep Learning Architectures)的重磅论文,核心同样指向记忆瓶颈。 就连最近这只彻底破圈的AI大龙虾——OpenClaw(原名Clawdbot),其亮点之一依旧是记忆。 也就是说,记忆≈今年全球AI圈集体押注的技术风口≈皇冠明珠。 几乎所有你能想到的大模型团队,都在加班加点往自家模型里塞记忆功能…… 但这一次,让我们把视线从这些科技巨头身上稍稍挪开,就会发现有一支后起之秀同样不容小觑。 他们就是陈天桥和邓亚峰带队的EverMind最新发布世界级长期记忆系统——EverMemOS,发布即SOTA。 一举打破多项记忆基准测试的同时,还能远超此前所有的基线方法。

其次,它是真正能用的。 不是只会跑测试的“花架子”,实际部署后效果照样能打。而且团队有底气有信心,技术代码全部开源。 为了方便开发者使用,他们刚刚还专门上线了云服务——现在只需一个最简单的API,就能直接将最前沿的大模型记忆能力装进自己的应用。 并且要知道,从EverMemOS正式立项到开源,团队只用了短短四个月时间,这是什么实力不必多说。 学习大脑记忆机制,成了。

启发于脑科学技术的研究成果,盛大一直以来非常重视长期记忆领域的研究。早在2024年10月,盛大团队就对外发布了长期记忆领域的纲领性文章《Long Term Memory-The Foundation of AI Self-Evolution》。 基于盛大多个团队在该领域的持续积累,EverMind在2025年8月正式启动EverMemOS项目,并于11月对外正式发布开源版本。 EverMemOS是EverMind打造的首款AI记忆基础设施,对比同赛道团队,似乎姗姗来迟。 Mem0、Zep等产品最早都能追溯到2024年,现在商业化最成功的开发者框架Letta(原MemGPT)也是2023年就开始起步。 EverMemOS却交出了亮眼的答卷:最晚入场,但效果弯道超车。 从技术角度看,它同时继承了基于外部存储和基于隐状态两种路径。不过业内并非没有尝试过此类方案,但EverMind显然在记忆提取的精准度和逻辑一致性上实现了更优的平衡。 原因在于EverMind抓住了精髓,用邓亚峰的话说,就是: 通过EverMemOS,我们赋予智能体一个活的、不断演化的历史。 这里的关键词其实是“活的”。那么如何能保存最鲜活的记忆呢?人类大脑。 这就引出了EverMind的独特思路——生物启发。

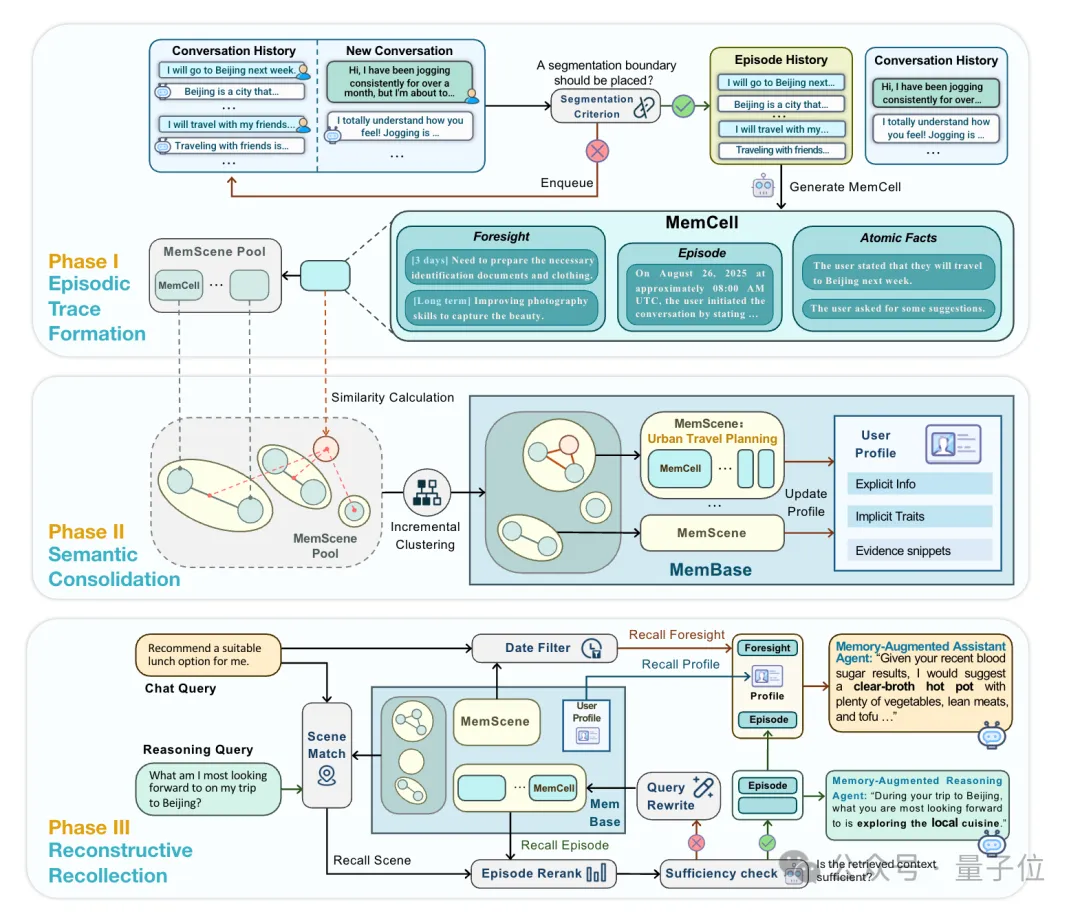

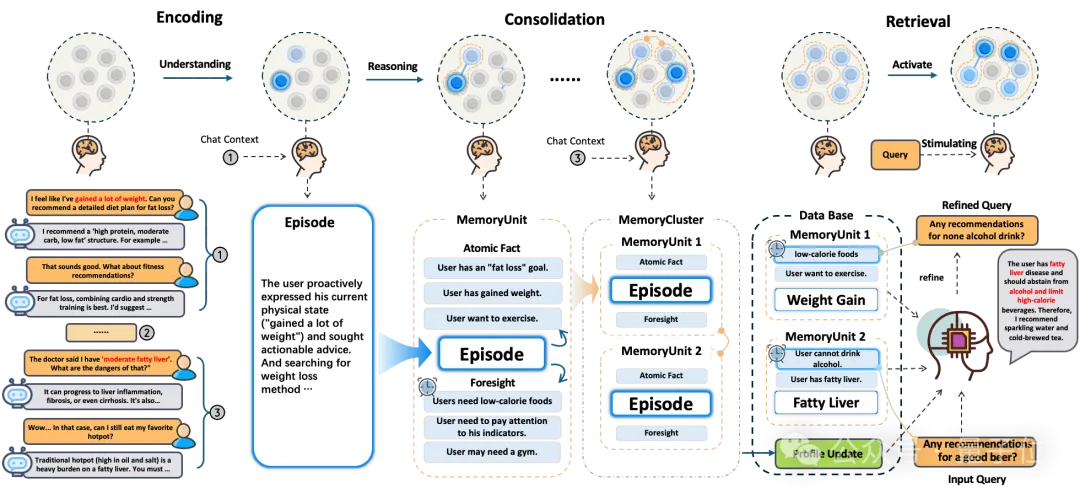

具体来讲,EverMemOS通过模拟人类记忆的形成并转化为计算框架,利用三阶段层层递进以实现大模型长期记忆的存储和提取: Step 1:情景轨迹构建。 对应人脑的海马体和内嗅皮层,可以将连续的对话内容拆分成一个个独立的记忆单元(MemCell),每个单元里不仅记录有完整的聊天内容,还包括一些关键事实、时效信息等。 Step 2:语义整合。 类比新皮层(前额叶皮层+颞叶皮层),系统会将内容相关的记忆单元归类在一起,形成主题化的记忆场景(MemScene),同时还会更新用户画像,区分用户的长期稳定偏好和短期临时状态。 Step 3:重构式回忆。 这一步对应的是前额叶皮层和海马体的协同机制,当用户提问时,系统就会在记忆场景的引导下进行智能检索,只挑选出必要且足够的记忆内容,用于后续的推理任务。 由此,AI学会像人类一样记忆——这不仅是知识的数据库存储,更是认知系统的深度整合。如此一来,即便是在多个Agent之间,也能实现信息的高效传递。

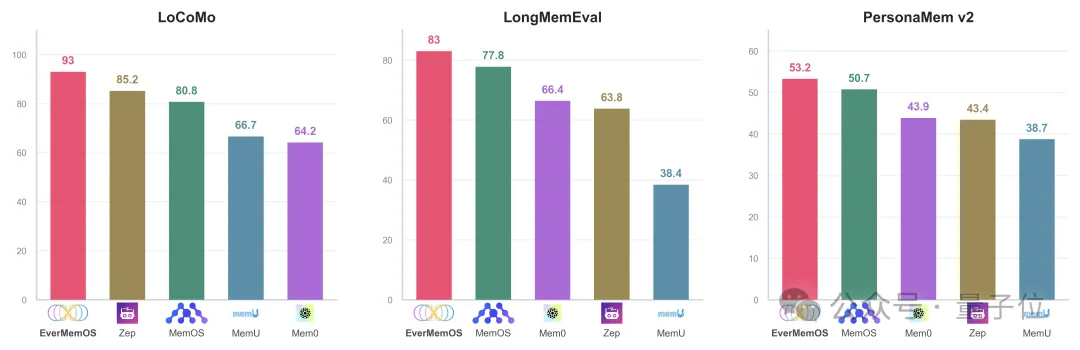

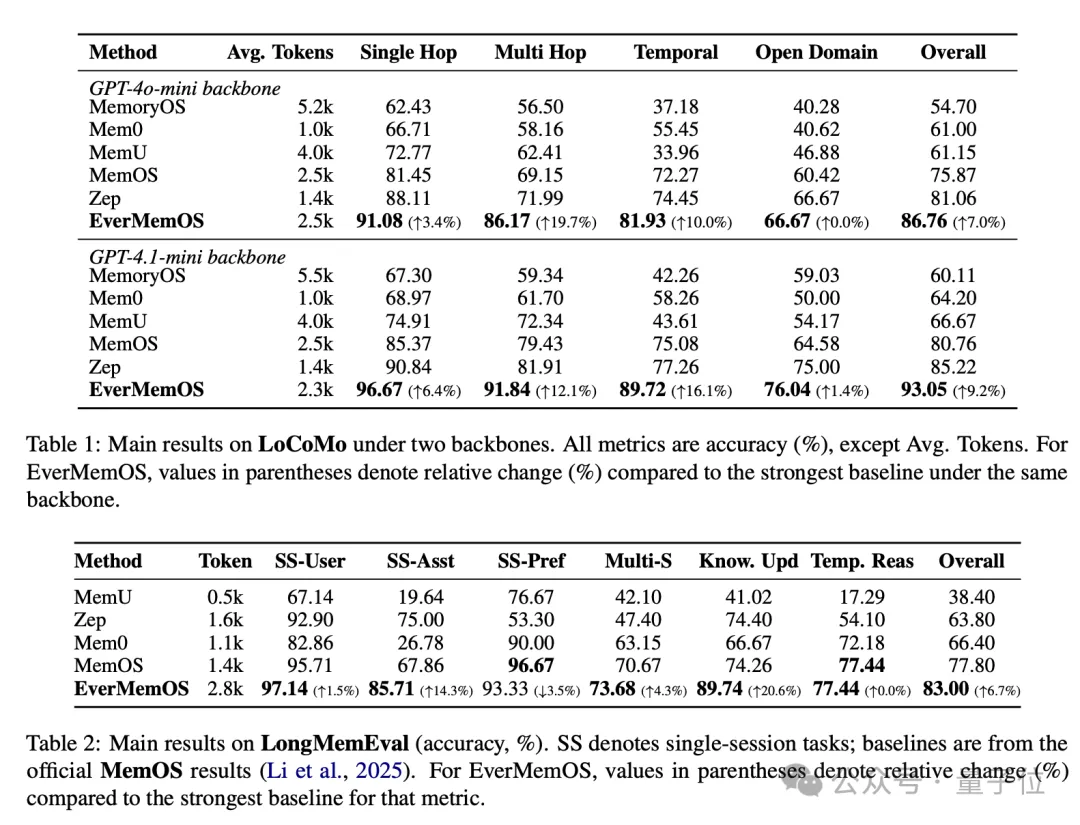

至于效果如何,咱们还是眼见为实,看看基准测试结果。 团队选取了4个主流记忆基准测试,以及多种大模型记忆增强方法。所有方法都基于同一基础大模型(GPT-4o-mini或GPT-4.1-mini)进行测试。 结果也很明显,EverMemOS大获全胜,全面超越现有记忆系统和全上下文模型。

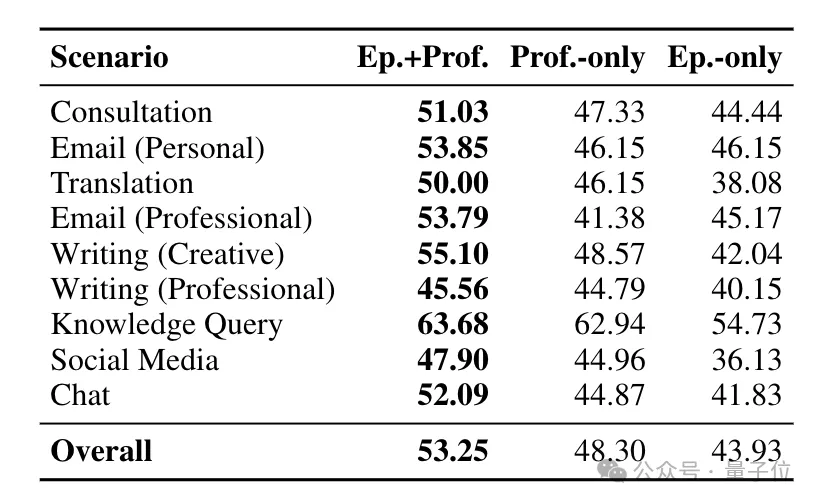

其中在LoCoMo上,准确率直接一跃来到93.05%,尤其是在多跳推理和时序任务上表现突出,分别提升19.7%和16.1%,同时token使用量和计算成本得到大幅度降低。 在多会话对话评估LongMemEval里,EverMemOS同样以83%的准确率位居榜首,说明在面对跨度极大、信息量极高的场景中,EverMemOS依旧能够精准检索和关联到过去的信息,并且通过持续交流还会不断进化完善自己。 HaluMem由MemTensor和中国电信研究院联合发布,是业界首个面向AI记忆系统的操作级幻觉评估基准。而EverMemOS在保证记忆完整性的同时,也显著改善了幻觉现象。 在PersonaMem v2里,EverMemOS在九个复杂场景中依旧全场最佳,保证了深度个性化和行为一致性。

足以见得,EverMemOS是相当全能的一枚选手,记性好、搜得准,关键还运行速度快、成本还够低,最长可突破百兆上下文限制。 一边帮大模型减负,一边帮大模型补记忆力,堪称大模型版安神补脑液。 连接智能的关键在记忆 那么最后,我们再来看看EverMind究竟意欲何为?毕竟又是发新技术、新平台,又是办比赛,这一套组合拳下来,野心可不小。 首先从供给侧讲,EverMind正在试图用EverMemOS重新定义大模型记忆的技术路线。 EverMemOS没有沿着原来已有的技术方案延展,而是实打实地摸索出了一条以脑科学+AI的独特路径,而且它的技术成熟度出乎意料地扎实,说明EverMemOS还只是EverMind布局的冰山一角。

郑重声明:此文内容为本网站转载企业宣传资讯,目的在于传播更多信息,与本站立场无关。仅供读者参考,并请自行核实相关内容。 |